光子芯片研究进展及展望:面向未来的计算系统

博士

中国科学院上海光学精密机械研究所助理研究员

王俊

中国科学院上海光学精密机械研究所研究员

微纳光电子功能材料实验室主任

芯片是人类最伟大的发明之一,也是现代电子信息产业的基础和核心。小到手机、电脑、数码相机,大到5G、物联网、云计算,全部都是基于芯片技术的不断突破。

半导体光刻工艺水平的发展是以芯片为核心的电子计算机的基石,目前半导体光刻的制造工艺几乎是摩尔定律的物理极限,随着制造工艺的越来越小,芯片内晶体管单元已经接近分子尺度,半导体制作工艺的“瓶颈效应”越来越明显。

随着全球化以及科技的高速发展,需要处理的数据量在急剧增加,相应的数据处理模型和算法也在不断增加,带来的结果就是对算力和功耗的要求不断提高。

而目前冯?诺依曼架构和哈佛架构的电子计算机存在传输瓶颈、功耗增加以及算力瓶颈等问题,已越来越难以满足大数据时代对算力与功耗的需求,因此提高运算速度同时降低运算功耗是目前面临的紧要问题。

面向未来的计算系统 ,光计算具有天然优势

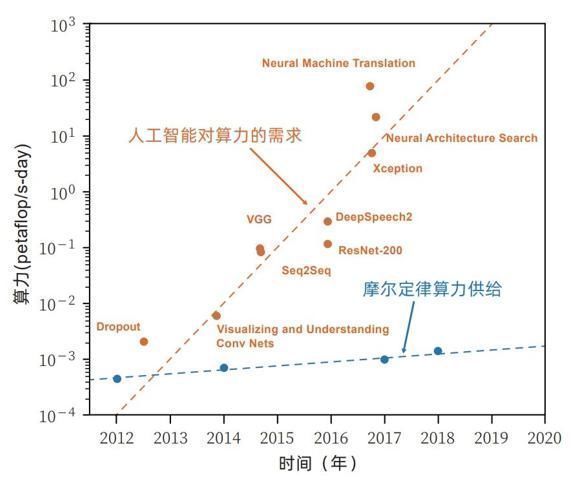

2016年,《自然》杂志社论“超越摩尔”中明确指出电子芯片难以为继。2019年,美国普林斯顿大学普鲁尼(Prucnal)等人撰文指出人工智能大数据时代对算力的需求每三个半月翻一番,远超摩尔定律所预测的算力供给量,即每18~24个月翻一番。同年,美国国防部高级研究计划局(DARPA)启动“未来计算系统”项目,目的是研究基于知识/推理的引擎,具备深度学习能力、高算力和低功耗的集成光子芯片。

利用光子计算方法替代传统电子计算方法将是解决摩尔定律困境以及冯?诺依曼架构的问题,即解决当前算力、功耗问题的极具潜力的途径之一。

光子具有光速传播、抗电磁干扰、任意叠加等特性,光学计算具有天然的并行计算特性,因而运算速度极快,且十分适合做并行运算。

工业界对光学技术充满信心,英特尔光子技术实验室主任马里奥?帕尼西亚(Mario Paniccia)曾预测说:“光学将能让计算机芯片设计师克服电子学的根本局限。”

IBM首席研究员戈弗里?伯尔(Goeffrey Burr)在“光学在人工智能硬件中的作用”一文中也曾指出:光学神经网络有望比传统的方法提供更好的能效。

在学术界,斯坦福大学米勒(D. A. B. Miller)教授、乔治华盛顿大学佐尔格(V. J. Sorger)教授等一大批科学家均对超低功耗光子器件、全光信息处理等有自己独到的见解。

光计算相比于电计算具有很多优势,例如:

光信号以光速传输,使速度得到巨大提升;

光具有天然的并行处理能力以及成熟的波分复用技术,从而使数据处理能力和容量及带宽大幅度提升;

光计算功耗有望低至10~18 J/bit,相同功耗下,光子器件比电子器件快数百倍。

从空间光计算到光子芯片

1946年,杜费(Duffieux)将傅立叶变换引入光学中进而发展出的傅立叶光学是光学计算技术的起源。

1950—1980年,科学家把光学和通信信息理论结合起来,把经典的成像光学理论赋予信息处理的角色,发展出基于模拟光计算的光学信息处理技术。

1980—2004年之间是光计算的黄金年代,人们已经提出大量光计算技术,包括以模拟光计算代表的光学模式识别、逻辑光计算、光学神经网络、光互连、光学全息存储等。

1987年,中科院上海光学精密机械研究所王之江院士在《中国科学院院刊》上撰文,提出了极具前瞻性的发展光计算技术的建议。此后,王之江院士等人在光学神经网络计算及光学逻辑计算方面开展了大量的工作。

1989年构建了第一个阴影投影法光学神经网络,提出两种光学神经网络Hopfield模型原始结构。

然而,由于人们对光计算的应用需求和应用场景不是很清晰,并且缺乏与光计算技术相匹配的光学硬件体系,光计算技术的发展比较缓慢。

下一篇:没有了